Controle Total Do DeepSeek R1: Passo a Passo Para Instalação Local

Table of Contents

Essa semana uma startup Chinesa movimentou o mercado de tecnologia com o DeekSeek R1, um novo modelo que está revolucionando os mercados essa semana (27 de janeiro de 2025), e causando preocupações sobre como o DeepSeek coleta seus dados. Afinal, sua política de privacidade afirma explicitamente que as informações coletadas são armazenadas em servidores localizados na República Popular da China. Isso inclui entradas dos usuários, como mensagens de chat, informações do dispositivo e dados de interação. Críticos estão preocupados com o potencial de censura de conteúdo e o uso indevido de dados coletados pelo governo chinês.

Levando isso em conta, dado que o DeepSeek é um modelo de código aberto, você pode executá-lo localmente no seu computador, testá-lo e evitar algumas dessas questões de privacidade de dados. Aqui está um guia rápido sobre como instalei o modelo no meu MacBook Air M1.

Instalando o Ollama

Ollama é uma plataforma que permite aos usuários executar e interagir com modelos de IA localmente em seus próprios dispositivos, sem a necessidade de acesso à nuvem. É gratuito e licenciado sob a licença MIT.

Você pode baixar o Ollama no site oficial: https://ollama.com/download

Depois de baixado, siga as instruções de instalação para o seu sistema operacional.

Baixando o Modelo DeepSeek R1

O Ollama oferece um repositório extenso de modelos que você pode baixar e executar localmente no seu dispositivo. Confira: https://ollama.com/library

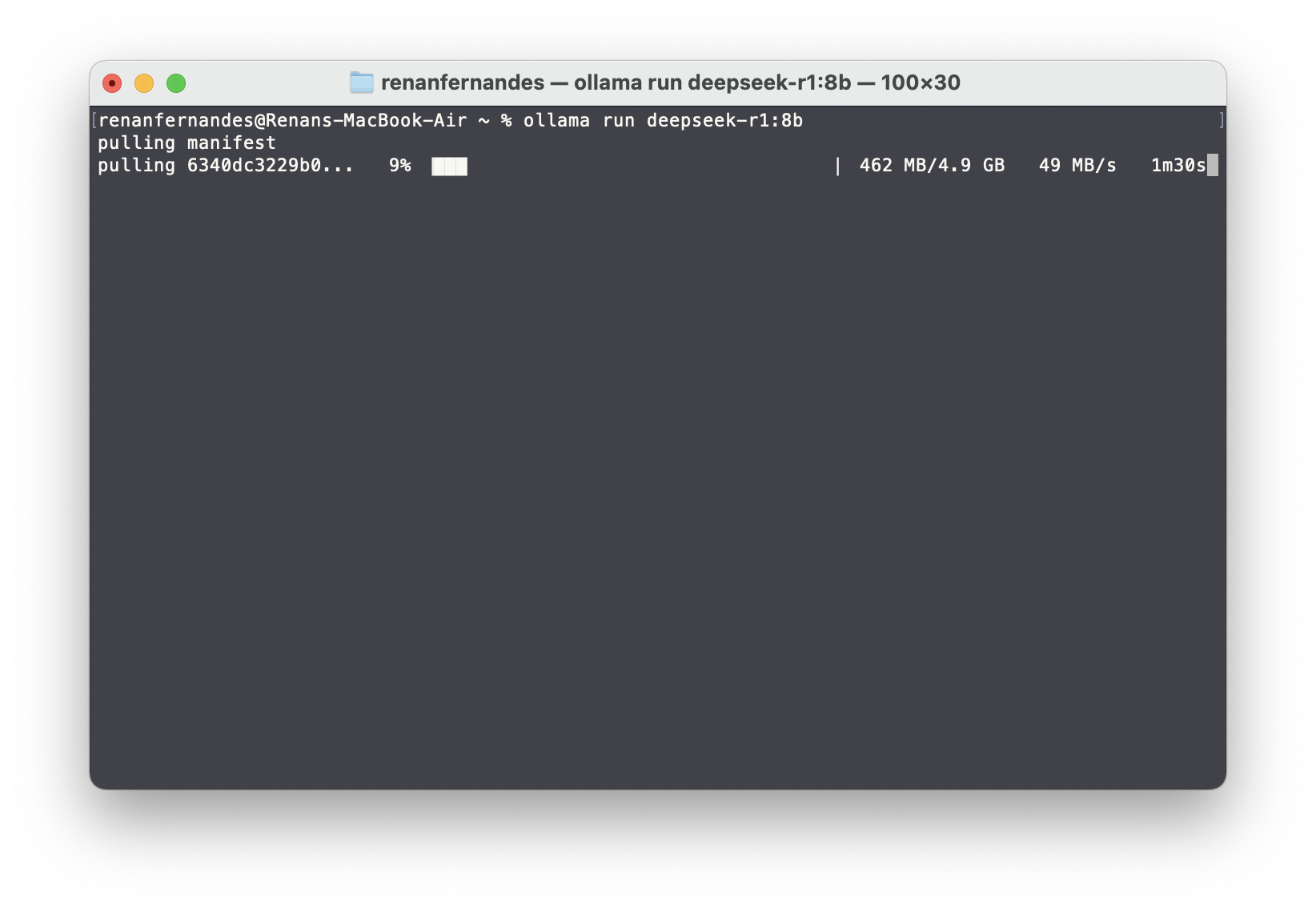

Lembre-se de que modelos maiores oferecem capacidades mais sofisticadas de IA, mas exigem maior poder computacional. Como tenho hardware limitado, optei pela versão 8B. Basta abrir seu terminal e executar:

ollama run deepseek-r1:8b

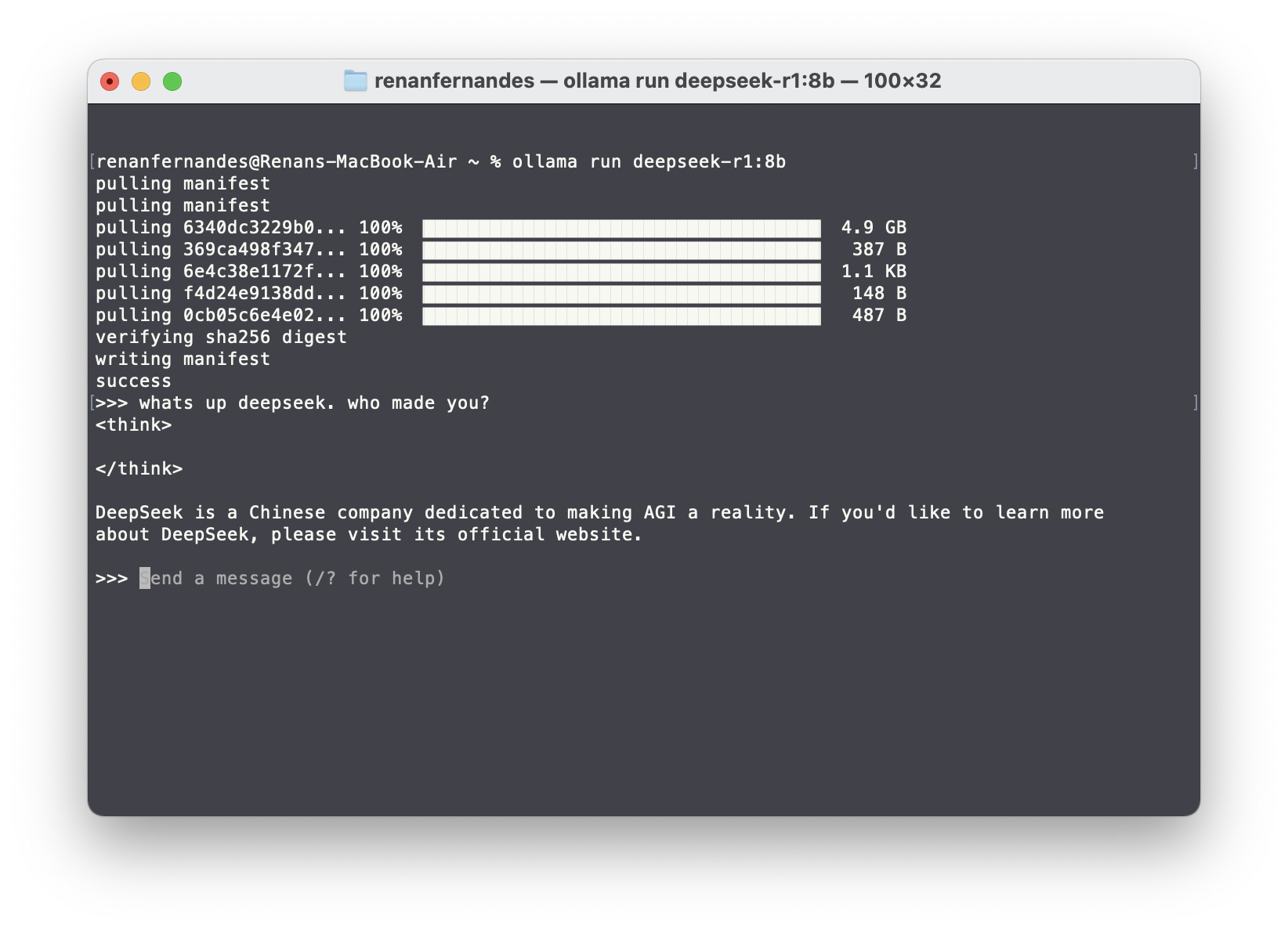

Depois que o download for concluído, você estará pronto para usar. O Ollama fornecerá um prompt onde você pode consultar o modelo e ver seu raciocínio:

É isso! Recomendo começar com um modelo menor para verificar se você tem poder de processamento suficiente antes de passar para uma versão maior.

Usando o Chatbox para uma Interface Melhor

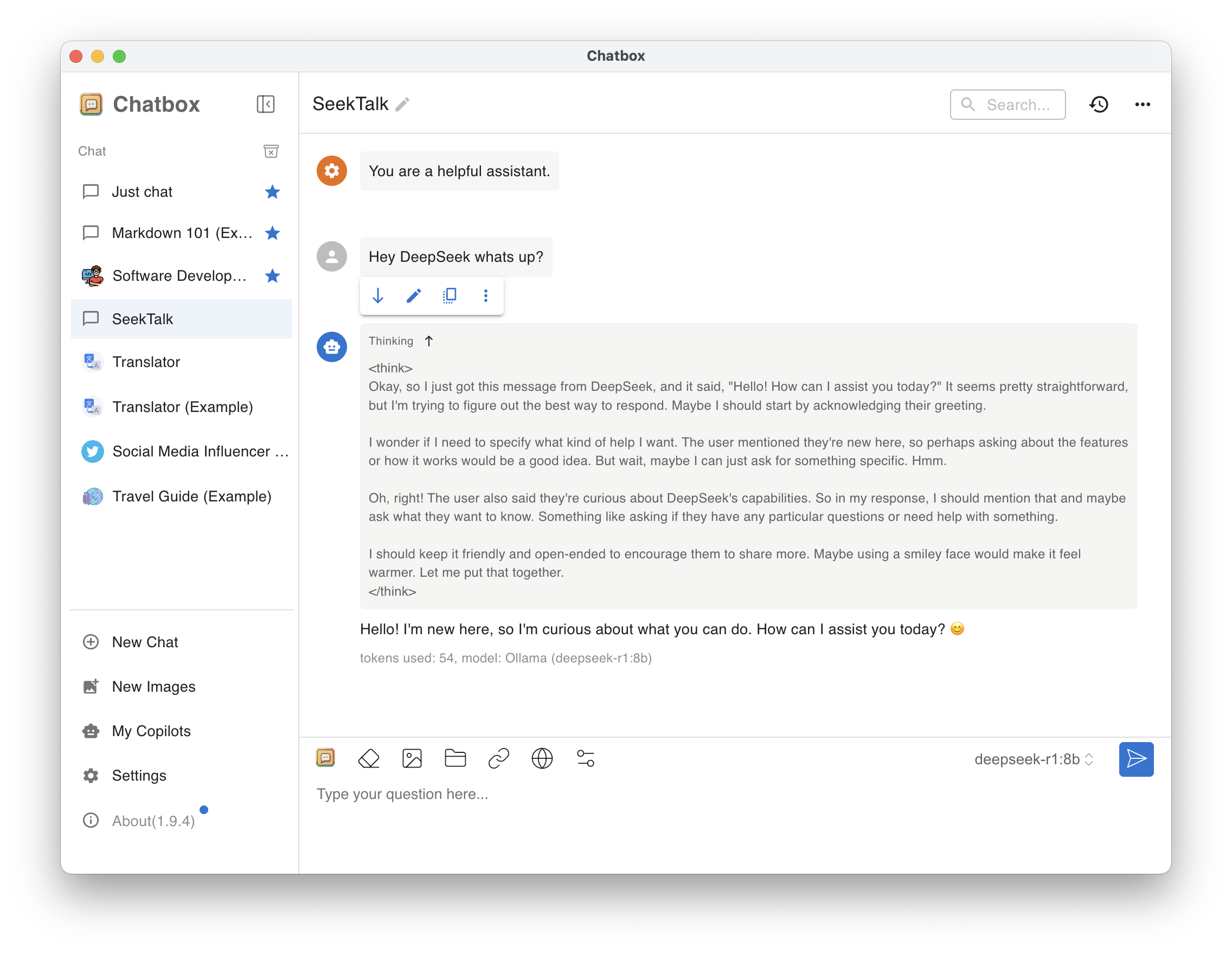

Embora o Ollama ofereça uma interface básica no terminal para consultar o modelo, existem outras interfaces gráficas que melhoram a experiência do usuário. Uma ótima alternativa é o Chatbox AI, que suporta imagens, documentos e a criação de copilotos personalizados.

Você pode baixar o Chatbox AI aqui: https://chatboxai.app/en

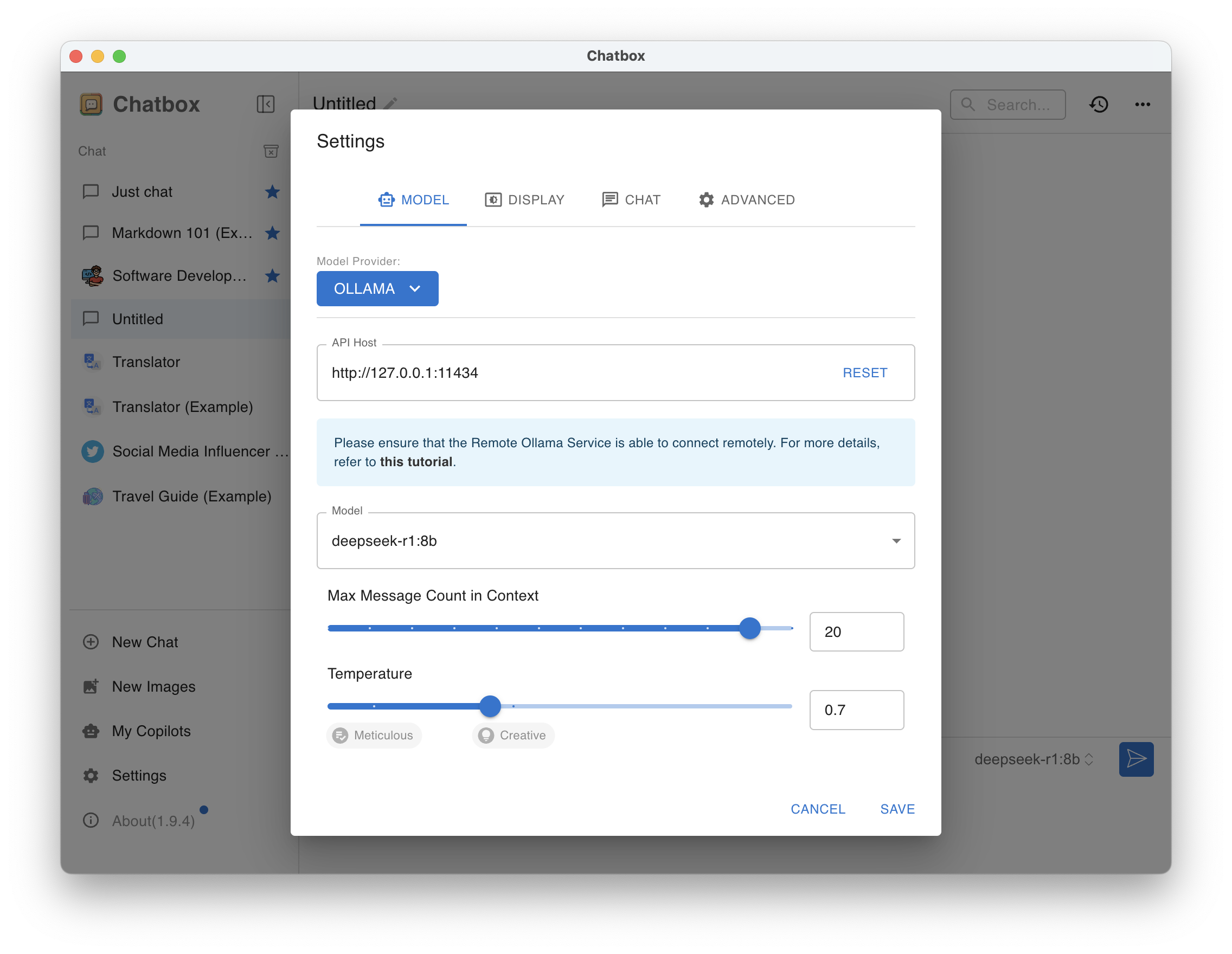

Configurando o Chatbox AI com o Ollama

- Abra o Chatbox AI.

- Navegue até Configurações.

- Em Provedor de Modelo, selecione Ollama.

- Escolha o modelo DeepSeek R1 que você baixou.

- Ajuste configurações adicionais como Temperatura (que controla a aleatoriedade das respostas), se necessário.

Agora você pode explorar e interagir com o modelo:

Conclusão

Executar o DeepSeek R1 localmente usando o Ollama é uma ótima maneira de explorar este modelo de IA e manter a sua privacidade.

Se você é novo em modelos de IA, recomendo começar com uma versão menor para testar o desempenho do seu sistema antes de escalar para uma versão maior. Seja para pesquisa, desenvolvimento ou curiosidade, rodar o modelo localmente garante que você tenha controle total sobre seus dados.

Ah! Aproveite para testar também o phi-4 da Microsoft, esse pequeno modelo é poderoso e com uma performance excelente

Experimente e me conte como foi!